Para colmo de males, tras leer un libro en el que se explicaban las distintas partes de una computador, una frase del autor retumbó en mi cabeza (y aún sigue retumbando de vez en cuando): -"Las computadoras son máquinas muy brillantes, pero a la vez muy estúpidas."- En pocas palabras se habían caído al suelo y roto en pedazos muchas de mis ilusiones. Pues posteriormente pude comprobar la frase. ¿Qué es una computadora sin un software? Nada. ¿Quiénes somos los responsables de programar ese softuare (programas de cómputo)? Nosotros los seres humanos. ¿Qué sucede si en uns "línea de código" tecleamos algo que resulte incorrecto o inentendible para el cacharrote informático? Se detiene y en el mejor de los casos nos dirá en dónde nos equivocamos pero al final, simplemente se detendrá y será tanto o más inutil que ese trapeador y esa escoba que estaban cerca de nuestro escritorio.

Pero es entonces cuando un libro que llegó a mis manos en los años ochenta: "Aprenda Divirtiéndose Computación" de Larry Gonick (Editorial EDIGONVILL 1985) o por su título en inglés "The Cartoon Guide to Computer Science" (1983) que me dejó perfectamente claro que, como todo artilugio que deriva de una tecnología tiene sus alcances y limitaciones. El amor por las Computadoras (y todo lo que derivaba de ellas) no solo regresó sino que se vió logarítmicamente incrementado.

Todo este preámbulo lo incluí para dar un contexto personalizado y así presentar, desde el punto de vista de alguien que estuvo en contacto con las Tecnologías de la Información desde hace ya décadas, cual ha sido La Evolución de las Plataformas Informáticas y de la Internet, todo esto en el formato de preguntas y respuestas.

¿Cómo podemos definir las ahora así llamadas Tecnologías de la Información?

Las Tecnologías de la Información (TI) se pueden definir como un conjunto de recursos, herramientas, métodos y sistemas utilizados para recopilar, procesar, almacenar, transmitir y gestionar información de manera eficiente y efectiva. Estas tecnologías abarcan una amplia gama de áreas y disciplinas relacionadas con la informática y la comunicación, y tienen un impacto significativo en prácticamente todos los aspectos de la sociedad moderna. Aquí hay una definición más detallada de las Tecnologías de la Información:- Recursos y herramientas: Las TI incluyen una variedad de recursos y herramientas tecnológicas, como computadoras, software, redes, dispositivos móviles, servidores, sistemas de almacenamiento, bases de datos y más. Estos recursos y herramientas son utilizados para realizar una amplia gama de tareas relacionadas con la gestión y el procesamiento de la información.

- Recopilación y procesamiento de información: Las TI facilitan la recopilación y el procesamiento de datos e información de diversas fuentes, como sensores, dispositivos, sistemas de información y usuarios. Esto incluye actividades como la captura de datos, la transformación de datos en información útil y la generación de conocimiento a partir de la información procesada.

- Almacenamiento y gestión de información: Las TI proporcionan herramientas y sistemas para almacenar y gestionar grandes volúmenes de información de manera eficiente y segura. Esto incluye sistemas de gestión de bases de datos, sistemas de almacenamiento en la nube, sistemas de archivos, y más, que permiten organizar, acceder y recuperar información de manera rápida y efectiva.

- Transmisión y comunicación de información: Las TI permiten la transmisión y comunicación de información a través de una variedad de medios y canales, como redes de computadoras, Internet, correo electrónico, mensajería instantánea, videoconferencias, entre otros. Esto facilita la colaboración, la comunicación y el intercambio de información entre individuos, organizaciones y sistemas.

- Automatización y optimización de procesos: Las TI se utilizan para automatizar y optimizar una amplia gama de procesos y actividades, tanto en el ámbito empresarial como en otros sectores. Esto incluye la automatización de tareas repetitivas, la optimización de flujos de trabajo, la gestión de recursos y la toma de decisiones basada en datos.

En general, ¿Cómo ha sido la Evolución de las Tecnologías de la Información?

Una manera en la que se puede ver y entender con facilidad esa evolución de las Tecnologías de la Información, es revisando las ahora denominadas Plataformas Informáticas. Hasta el momento podemos afirmar categóricamente que son tres las Plataformas Informáticas que han marcado esta evolción.

¿Cuáles son las características de la Primera Plataforma Informática?

La Primera Plataforma Informática, que abarca la primera generación de computadoras utilizadas en las décadas de 1950, 1960 y parte de la de 1970, se caracteriza por una serie de aspectos distintivos que marcaron el comienzo de la era informática moderna. Aquí tienes algunas de las características principales:- Mainframes: La Primera Plataforma estaba dominada por mainframes, que eran grandes computadoras centralizadas diseñadas para manejar grandes volúmenes de procesamiento de datos y cálculos complejos. Estos mainframes eran extremadamente costosos y se encontraban principalmente en instituciones gubernamentales, grandes corporaciones y universidades.

- Batch Processing: El procesamiento por lotes era el método predominante para procesar datos en la Primera Plataforma. Los programas y datos se agrupaban en lotes y se procesaban secuencialmente por el mainframe, con una entrada de datos en un extremo y una salida de resultados en el otro. Este enfoque era eficiente para tareas repetitivas y de alta carga de datos.

- Terminal Access: Los usuarios interactuaban con los mainframes a través de terminales, que eran dispositivos simples de entrada/salida de datos. Estos terminales podían ser tanto unidades físicas como software que emulaba la funcionalidad de una terminal. La interacción era a menudo a través de líneas de comandos y no había interfaces gráficas de usuario como las que conocemos hoy.

- Alta fiabilidad y disponibilidad: Los mainframes estaban diseñados para ofrecer un alto nivel de fiabilidad y disponibilidad. Se utilizaron redundancias en hardware y software para minimizar el tiempo de inactividad y garantizar la integridad de los datos, ya que se consideraba crucial para las operaciones empresariales críticas y los cálculos científicos.

- Lenguajes de programación: Surgieron varios lenguajes de programación en esta época, incluidos FORTRAN (para cálculos científicos), COBOL (para aplicaciones empresariales) y assembly language (para programación de bajo nivel directamente en el hardware).

- Limitaciones de almacenamiento y velocidad: Aunque los mainframes de la Primera Plataforma eran poderosos para su época, tenían limitaciones significativas en términos de capacidad de almacenamiento y velocidad de procesamiento en comparación con las computadoras modernas.

¿Cuáles son las características de la Segunda Plataforma Informática?

La Segunda Plataforma Informática marcó una evolución significativa en la computación, abarcando principalmente las décadas de 1980 y 1990. Aquí tienes algunas de sus características principales:Ordenadores Personales (PCs): La Segunda Plataforma Informática se caracterizó por la proliferación de los ordenadores personales (PCs). Los PCs eran más asequibles, más pequeños y más accesibles para los consumidores y las empresas que los mainframes de la Primera Plataforma. Esto llevó a una descentralización de la computación, con PCs siendo utilizados en hogares, oficinas y escuelas.

Sistemas Operativos Gráficos: Los sistemas operativos gráficos se convirtieron en la norma durante esta época. Ejemplos notables incluyen el sistema operativo Windows de Microsoft y el sistema operativo MacOS de Apple. Estos sistemas operativos permitían a los usuarios interactuar con la computadora a través de una interfaz gráfica de usuario (GUI) en lugar de depender exclusivamente de comandos de texto.

Redes Locales (LANs): La proliferación de las redes locales (LANs) permitió la interconexión de PCs en entornos de trabajo y hogares. Esto facilitó la colaboración y el intercambio de recursos como impresoras y archivos entre usuarios conectados en una misma red.

Internet: Aunque la Internet ya existía en la Primera Plataforma Informática (como ARPANET), fue durante la Segunda Plataforma cuando comenzó a popularizarse entre el público en general. El surgimiento de la World Wide Web y los navegadores web como Netscape Navigator y Internet Explorer permitieron a los usuarios acceder fácilmente a información y servicios en línea.

Multimedia: Los avances en hardware y software durante la Segunda Plataforma permitieron la proliferación de contenido multimedia. Se desarrollaron formatos de archivo como JPEG para imágenes, MP3 para música y MPEG para video, lo que permitió a los usuarios crear, compartir y consumir una amplia gama de contenido multimedia en sus PCs.

Aplicaciones de Productividad: Surgieron numerosas aplicaciones de productividad durante esta época, incluyendo suites de oficina como Microsoft Office y aplicaciones de diseño gráfico como Adobe Photoshop. Estas aplicaciones permitieron a los usuarios realizar una variedad de tareas, desde procesamiento de texto hasta diseño gráfico, en sus PCs.

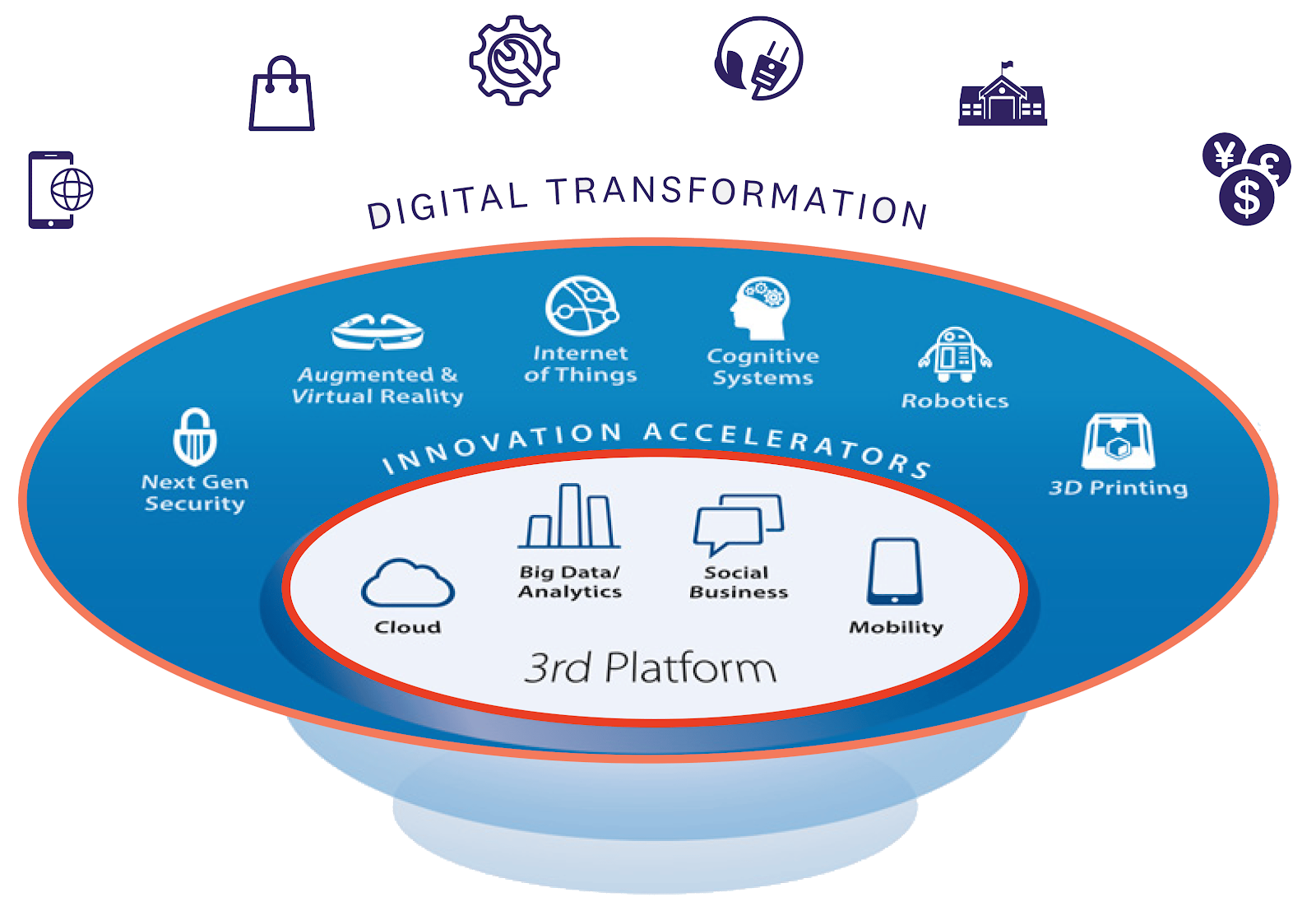

¿Cuáles son las características de la Tercera Plataforma Informática?

La Tercera Plataforma Informática es una evolución que abarca desde finales del siglo XX hasta la actualidad, y se caracteriza por una serie de avances tecnológicos que han transformado significativamente la forma en que interactuamos con la información y la tecnología. Aquí tienes algunas de sus características principales:- Computación en la nube (Cloud Computing): La computación en la nube permite el acceso a recursos informáticos, como almacenamiento, servidores y aplicaciones, a través de Internet. Esto proporciona una mayor flexibilidad, escalabilidad y eficiencia en comparación con la infraestructura tradicional de TI basada en servidores locales.

- Big Data: El término "Big Data" se refiere al manejo y análisis de grandes volúmenes de datos, tanto estructurados como no estructurados. La Tercera Plataforma ha visto un explosivo crecimiento en la generación y el almacenamiento de datos, y las tecnologías de Big Data permiten extraer información valiosa de estos datos para tomar decisiones informadas.

- Movilidad: La proliferación de dispositivos móviles, como teléfonos inteligentes y tabletas, ha cambiado la forma en que accedemos a la información y realizamos tareas diarias. La movilidad permite a los usuarios acceder a servicios y aplicaciones desde cualquier lugar y en cualquier momento, lo que ha impulsado la demanda de experiencias de usuario móviles y optimizadas para dispositivos móviles.

- Redes Sociales: Las redes sociales han transformado la forma en que nos conectamos, interactuamos y compartimos información en línea. Plataformas como Facebook, Twitter, Instagram y LinkedIn han creado comunidades en línea y han facilitado la colaboración, la comunicación y el intercambio de contenido entre usuarios de todo el mundo.

- Internet de las Cosas (IoT): El Internet de las Cosas se refiere a la interconexión de dispositivos físicos a través de Internet, permitiendo la recopilación y el intercambio de datos en tiempo real. Esto ha dado lugar a una amplia gama de aplicaciones en áreas como la domótica, la salud, la agricultura, la industria y más.

- Inteligencia Artificial (IA) y Aprendizaje Automático (Machine Learning): La IA y el aprendizaje automático están revolucionando diversos campos, desde la atención médica hasta la publicidad en línea. Estas tecnologías permiten a las máquinas aprender de datos y realizar tareas que tradicionalmente requerían la intervención humana, como el reconocimiento de voz, la clasificación de imágenes y la toma de decisiones automatizadas.

¿Existe una Cuarta Plataforma?

La noción de una "Cuarta Plataforma Informática" aún no es tan establecida como las anteriores, pero se refiere a un conjunto de tecnologías emergentes que están moldeando el futuro de la computación y la sociedad digital. Aunque no existe un consenso definitivo sobre cuáles serán todas sus características, hay ciertas tendencias y tecnologías clave que están comenzando a definir esta nueva fase. Aquí hay algunas posibles características de la Cuarta Plataforma Informática:- Computación Cuántica: La computación cuántica tiene el potencial de revolucionar la forma en que procesamos y analizamos datos. Basada en los principios de la mecánica cuántica, esta tecnología podría resolver problemas extremadamente complejos de manera mucho más eficiente que las computadoras clásicas.

- Inteligencia Artificial Generalizada: La Cuarta Plataforma podría estar marcada por el avance hacia una inteligencia artificial más generalizada, que puede abordar una variedad más amplia de tareas cognitivas y adaptarse a diferentes contextos de manera más efectiva. Esto podría incluir sistemas que pueden razonar, comprender el lenguaje natural y aprender de manera más flexible.

- Blockchain y Criptomonedas: La tecnología blockchain, conocida por su uso en criptomonedas como Bitcoin y Ethereum, está siendo explorada para una variedad de aplicaciones más allá de las transacciones financieras. Esto incluye contratos inteligentes, gestión de identidad, votación electrónica, trazabilidad de la cadena de suministro y más.

- Realidad Aumentada y Virtual: La realidad aumentada (AR) y la realidad virtual (VR) están ganando terreno en la Cuarta Plataforma, ofreciendo experiencias inmersivas que combinan el mundo físico con el digital. Esto tiene aplicaciones en áreas como el entretenimiento, la educación, la capacitación y la colaboración.

- Edge Computing: Con el aumento de dispositivos conectados y la generación de datos en el borde de la red, el edge computing se está convirtiendo en una parte importante de la infraestructura de la Cuarta Plataforma. Esto implica procesar datos cerca de donde se generan, lo que reduce la latencia y la carga en las redes centrales.

- Biotecnología y Computación Bioinspirada: La Cuarta Plataforma podría ver una mayor integración entre la tecnología y la biología, con avances en áreas como la ingeniería genética, la medicina personalizada y la computación bioinspirada, que se inspira en los procesos biológicos para resolver problemas de manera eficiente.

Ahora llegó el turno de hablar de manera específica acerca de la Internet. Que como vimos aunque formalmente nace dentro de la Primera Plataforma Informática (como ARPANET), es en la Segunda Plataforma Informática (sobre todo por apegarse a la Arquitectura Cliente-Servidor y ser altamente popular).

Es precisamente la Internet, la World Wide Web o simplemente Web, la que también ha evolucionado en varias versiones. Comencemos entonces preguntándonos

¿Qué es la Web?

En términos simples, la Web es una vasta colección de documentos interconectados entre sí mediante enlaces (también conocidos como hipervínculos), que permiten a los usuarios navegar de un documento a otro con solo hacer clic en estos enlaces. Estos documentos pueden incluir páginas web, imágenes, videos, archivos de audio, aplicaciones en línea y más.

La Web se basa en varios protocolos y estándares, siendo el más notable el Protocolo de Transferencia de Hipertexto (HTTP), que permite la transmisión de datos entre servidores web y navegadores de Internet. Otro estándar clave es el Lenguaje de Marcado de Hipertexto (HTML), que se utiliza para crear y formatear documentos web.

Además de HTTP y HTML, la Web también se apoya en otros estándares y tecnologías, como los navegadores web (por ejemplo, Chrome, Firefox, Safari), los servidores web (como Apache, Nginx), los lenguajes de programación del lado del servidor (como PHP, Python, Ruby), las hojas de estilo en cascada (CSS), JavaScript, y más.

¿Cuáles han sido, son y se tiene ya previsto que a mediano plazo serán las generaciones de la Web?

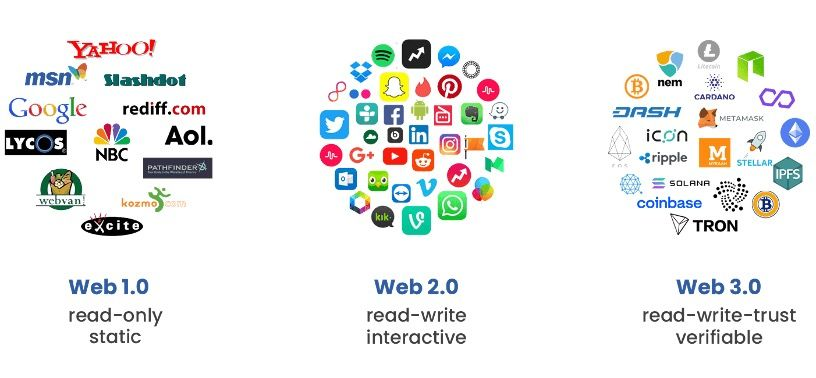

La Web 1.0, la Web 2.0 y la Web 3.0 son términos que se utilizan para describir diferentes etapas en la evolución de Internet y la World Wide Web. Aquí tienes una breve descripción de cada una:

Web 1.0: Esta es la primera fase de la web, que se desarrolló principalmente en la década de 1990. En esta etapa, la web era estática y principalmente unidireccional, con un énfasis en el consumo de contenido. Los sitios web eran principalmente informativos y no permitían mucha interacción por parte de los usuarios. Las páginas web se construían con HTML básico y eran estáticas en su diseño.

Web 2.0: La Web 2.0 emergió a principios de los años 2000 y representa una evolución significativa de la Web 1.0. En esta etapa, los sitios web se volvieron más dinámicos y colaborativos, permitiendo una mayor interacción entre los usuarios. Se introdujeron aplicaciones web interactivas, redes sociales, blogs, wikis y otras plataformas que fomentaban la participación activa de los usuarios. La Web 2.0 se caracteriza por la creación y el intercambio de contenido generado por el usuario, así como por la colaboración en línea.

Web 3.0: La Web 3.0 es una fase de desarrollo más reciente y aún en evolución. Se refiere a una web más inteligente, descentralizada y personalizada. La Web 3.0 está impulsada por tecnologías como la inteligencia artificial, el aprendizaje automático, la blockchain y el Internet de las cosas (IoT). Se espera que la Web 3.0 permita experiencias en línea más personalizadas, seguras y eficientes, así como una mayor autonomía y control por parte de los usuarios sobre sus datos y actividades en línea.

¿Que SÍ y qué NO son la Web 1.0, la Web 2.0 y la Web 3.0?

Web 1.0:

SÍ es:

- Estática y principalmente unidireccional.

- Principalmente informativa, con énfasis en el consumo de contenido.

- Construida con HTML básico y diseño estático.

- Caracterizada por la presencia de sitios web como portales de información estática y páginas corporativas.

NO es:

- Interactiva ni colaborativa.

- Centrada en la participación activa de los usuarios.

- Dinámica en términos de contenido y diseño.

- Impulsada por aplicaciones web avanzadas o redes sociales.

Web 2.0:

SÍ es:

- Dinámica y colaborativa.

- Interactiva, permitiendo una mayor participación de los usuarios.

- Caracterizada por la creación y el intercambio de contenido generado por el usuario.

- Impulsada por aplicaciones web interactivas, redes sociales, blogs y wikis.

NO es:

- Estática ni unidireccional.

- Exclusivamente informativa, aunque aún contiene elementos de información.

- Restringida a la participación pasiva de los usuarios.

- Limitada a tecnologías y plataformas web básicas.

Web 3.0:

SÍ es:

- Inteligente, descentralizada y personalizada.

- Basada en tecnologías como inteligencia artificial, blockchain, IoT, entre otras.

- Proporciona experiencias en línea más seguras, eficientes y personalizadas.

- Da mayor autonomía y control a los usuarios sobre sus datos y actividades en línea.

NO es:

- Limitada a tecnologías web tradicionales.

- Una simple extensión de la Web 2.0, sino una evolución significativa.

- Totalmente definida ni estática, ya que aún está en evolución y desarrollo.

- Exclusivamente centrada en la interacción humana, sino que también puede involucrar sistemas y dispositivos autónomos.

¿Cuáles serían las aplicaciones prácticas de la Web 1.0, la Web 2.0 y la Web 3.0?

Web 1.0:

Sitios web estáticos: En la Web 1.0, los sitios web eran principalmente estáticos y proporcionaban información básica sobre empresas, organizaciones, productos y servicios. Estos sitios eran útiles para la presentación de información y recursos, pero carecían de interactividad significativa.

Portales unidireccionales de información: Muchos de los sitios web prominentes en la Web 1.0 eran portales de información que ofrecían contenido estático, como noticias, artículos y recursos de referencia. Ejemplos incluyen sitios web de noticias, enciclopedias en línea y directorios de empresas.

Web 2.0:

Redes sociales: Las redes sociales como Facebook, Twitter, Instagram y LinkedIn son ejemplos prominentes de aplicaciones de la Web 2.0. Estas plataformas permiten a los usuarios crear perfiles, conectarse con otros usuarios, compartir contenido, participar en conversaciones y colaborar en línea.

Blogs y wikis: Los blogs permiten a los usuarios publicar contenido en línea de manera regular, mientras que los wikis permiten la edición colaborativa de contenido por parte de múltiples usuarios. Ejemplos populares incluyen WordPress para blogs y Wikipedia para wikis.

Aplicaciones web interactivas: Las aplicaciones web como Google Maps, Gmail, YouTube y Dropbox son ejemplos de aplicaciones interactivas de la Web 2.0 que permiten a los usuarios realizar acciones específicas en línea, como visualizar mapas, enviar correos electrónicos, ver videos y almacenar archivos.

Web 3.0:

Contratos inteligentes: En la Web 3.0, la tecnología blockchain permite la ejecución de contratos inteligentes, que son acuerdos digitales autoejecutables que se ejecutan automáticamente cuando se cumplen ciertas condiciones predefinidas. Estos contratos tienen aplicaciones prácticas en áreas como finanzas, bienes raíces y logística.

Personalización de contenido: La Web 3.0 utiliza tecnologías de inteligencia artificial y aprendizaje automático para ofrecer experiencias en línea más personalizadas. Esto se ve en plataformas como Netflix, que recomienda contenido basado en el historial de visualización del usuario, y Spotify, que crea listas de reproducción personalizadas según los gustos musicales del usuario.

Internet de las cosas (IoT): En la Web 3.0, los dispositivos conectados a Internet, como sensores, cámaras y dispositivos domésticos inteligentes, pueden comunicarse entre sí y con los usuarios para proporcionar información en tiempo real y automatizar tareas. Ejemplos incluyen termostatos inteligentes, sistemas de seguridad doméstica y dispositivos de seguimiento de fitness.

¿Cuál sería el tiempo de vida y/o vigencia de la Web 1.0, la Web 2.0 y la Web 3.0?

El concepto de "tiempo de vida" en el contexto de las diferentes etapas de la web puede ser un tanto subjetivo y depende de varios factores, incluyendo la evolución tecnológica, las tendencias del mercado y las necesidades de los usuarios. Sin embargo, puedo ofrecerte algunas observaciones sobre cómo ha evolucionado y podría evolucionar cada etapa:

Web 1.0:

La Web 1.0 podría considerarse como una etapa inicial en la evolución de Internet y la web.

En términos de tiempo de vida, aunque la Web 1.0 como concepto ya no es predominante en la actualidad, muchas de las tecnologías y prácticas asociadas aún persisten en la web moderna.

Sitios web estáticos y portales de información todavía existen, aunque han evolucionado para incorporar elementos de interactividad y participación del usuario.

Web 2.0:

La Web 2.0 marcó un cambio significativo hacia la interactividad y la participación del usuario en la web.

En términos de tiempo de vida, la Web 2.0 ha tenido una influencia duradera y sigue siendo relevante en la actualidad.

Muchas de las plataformas y tecnologías asociadas con la Web 2.0, como las redes sociales, los blogs y las aplicaciones web interactivas, continúan siendo fundamentales en el panorama de Internet y se han convertido en parte integral de la vida cotidiana en línea para millones de personas en todo el mundo.

Web 3.0:

La Web 3.0 es una fase de desarrollo más reciente y aún en evolución, que se centra en aspectos como la inteligencia artificial, la descentralización y la personalización.

En términos de tiempo de vida, la Web 3.0 está emergiendo y se espera que continúe evolucionando en los próximos años.

A medida que tecnologías como la inteligencia artificial, la blockchain y el Internet de las cosas maduran y se integran más en nuestras vidas y en la infraestructura de Internet, la Web 3.0 probablemente seguirá expandiéndose y transformando la forma en que interactuamos con la web y con el mundo digital en general.

Conclusión

Las Tecnologías de la Información engloban una variedad de recursos, herramientas y sistemas utilizados para recopilar, procesar, almacenar, transmitir y gestionar información de manera efectiva, lo que tiene un impacto significativo en la forma en que vivimos, trabajamos y nos relacionamos en la era digital.

La Primera Plataforma Informática sentó las bases para el desarrollo posterior de la informática, estableciendo principios fundamentales en términos de arquitectura de computadoras, procesamiento de datos y desarrollo de software.

La Segunda Plataforma Informática estuvo marcada por la descentralización de la computación, la proliferación de PCs y redes locales, el desarrollo de sistemas operativos gráficos, la popularización de Internet y el surgimiento de contenido multimedia y aplicaciones de productividad. Estas características sentaron las bases para la era digital moderna y continuaron influyendo en la evolución de la tecnología de la información en las décadas siguientes.

La Tercera Plataforma Informática se caracteriza por la adopción generalizada de la computación en la nube, el análisis de Big Data, la movilidad, las redes sociales, el Internet de las Cosas y la inteligencia artificial. Estos avances tecnológicos están impulsando la innovación en una amplia gama de industrias y están transformando la forma en que vivimos, trabajamos y nos relacionamos en la era digital.

La Web es un sistema de información global que permite a los usuarios acceder y compartir una amplia gama de recursos en línea, facilitando la comunicación, la colaboración, el entretenimiento, el comercio y mucho más en la era digital.

Estamos seguros que en un lustro hacia el futuro, veremos más cambios y nuevas etapas evolutivas para nuestras Tecnologías de la información en general, así como para la Web en lo particular.

¿Está Usted preparado para todo lo ya hay y todo lo que está por venir?